Oubliez l’IA générative, ce n’est pas moi qui le dis, mais Yann LeCun, le gourou tricolore de l’intelligence artificielle. Sur le long chemin vers l’IA générale, le scientifique en chef et vice-président de Meta mise sur un modèle basé sur l’objectif, capable d’apprendre, de raisonner et de planifier en toute sécurité. Tout un programme.

IA par ci, IA par là. L’intelligence artificielle fait les choux gras des médias et des réseaux sociaux, Clubic le premier. Alors, quand Meta m'a proposé de me rendre dans ses locaux pour parler d’intelligence artificielle avec ses experts maison, je n'ai pas hésité deux secondes. Yann LeCun, Joëlle Pineau, Naila Murray… Le casting était alléchant, tout comme la promesse d’y voir plus clair dans ce maelstrom d’innovations et de technologies.

ChatGPT, la surprise qu'il n'a pas vue venir

Lorsque Yann LeCun, Vice President et Chief AI Scientist de Meta prend la parole, ça devient tout de suite passionnant et instructif. Prix Turing 2018 et membre l’Académie nationale des sciences aux États-Unis, nous nous apercevons instantanément que notre interlocuteur n’a pas vraiment sa langue dans sa poche : « ChatGPT ? Une surprise, un engouement populaire que nous n’avons pas su anticiper alors que ce n’était pas le modèle d’IA générative le plus avancé de l’époque ». Intérieurement, je tique un peu en me souvenant du bad buzz provoqué à l'époque par la mise en ligne de Galactica, le modèle de langage de Meta aussitôt retiré de la circulation fin 2022.

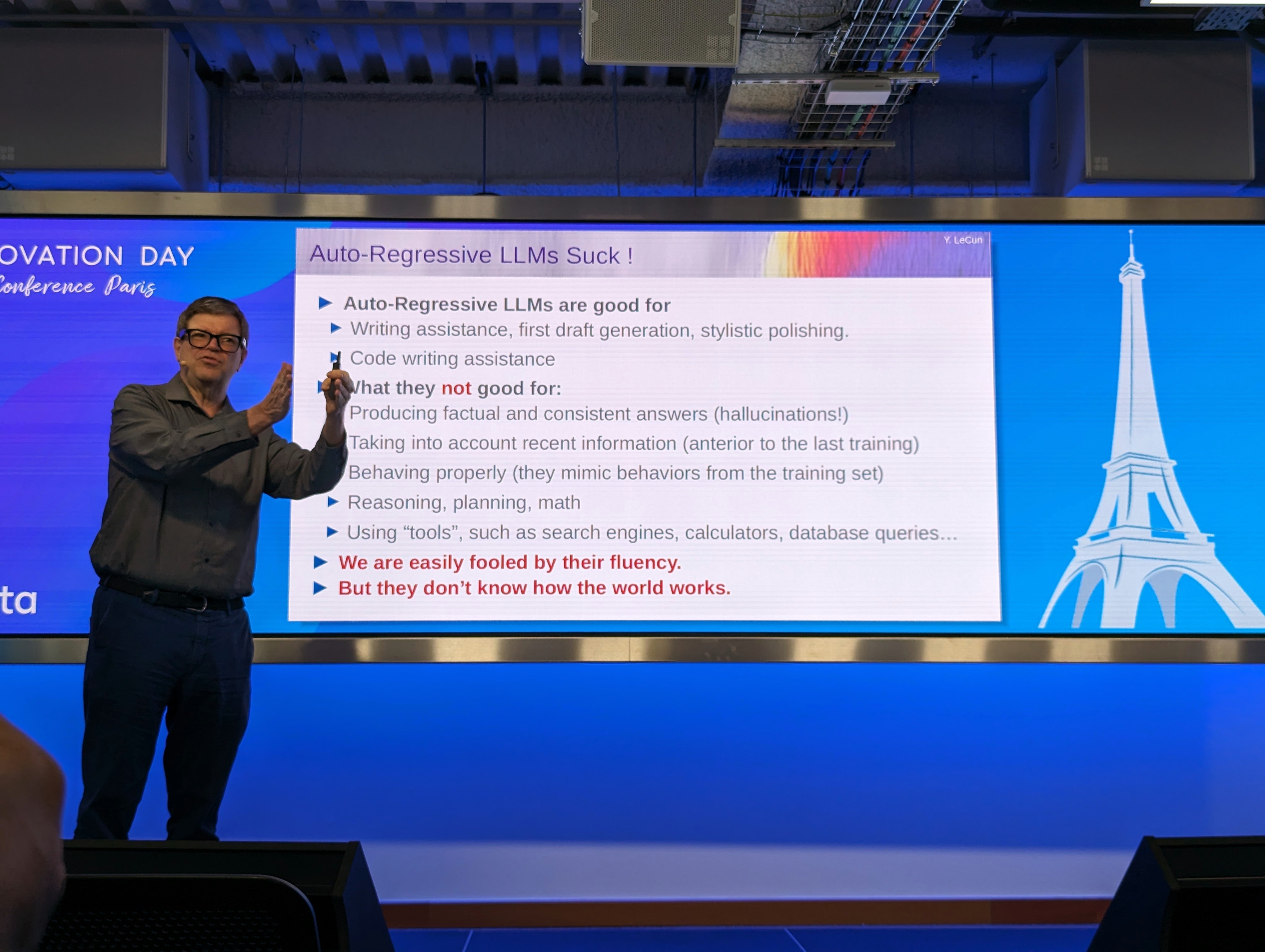

Alors qu’Elon Musk prévoit l’émergence d’une IA plus intelligente que l’être humain dès l’année prochaine, Yann LeCun dénote là aussi dans le concert ambiant en expliquant que le niveau des IA génératives actuelles est bien trop limité : « elles ne peuvent pas réfléchir par elle-même, elles commettent des erreurs basiques, elles hallucinent... ».

Celles-ci devraient se cantonner à l’aide à l’écriture, à l’édition ou, encore, à assister les développeurs dans le codage de leurs programmes informatiques. Pour lui, bien que LLaMA soit aussi un une IA générative développée par Meta (la version 3 a été officiellement annoncée cette semaine), il y aurait beaucoup mieux à faire en attendant d’atteindre le niveau d’une IA générale qui, au passage, ne serait pas près d’arriver. 10 ans ? 15 ans ? On ne sait pas ! L’homme aux Ray-Ban connectées préférant d’ailleurs parler d’AMI, l’acronyme d’Advanced Machine Intelligence.

S'inspirer des humains ou des animaux pour l'apprentissage

L’un des points fondamentaux à améliorer serait le machine learning ou l'apprentissage automatique en français. L’idée serait de s’inspirer un peu plus des humains, voire même des animaux, qui apprennent des tâches beaucoup plus rapidement que n’importe quelle machine existante, qui comprennent en un clin d’œil le monde les entourant et qui peuvent élaborer rapidement un plan. C’est ce sens commun, ce comportement basé sur les objectifs qu’il faudrait copier. « Même un chat est capable de planifier des tâches complexes » rappelle Yann LeCun, justifiant le travail encore à accomplir. Voilà des propos qui flattent littéralement mon ego de propriétaire de chat.

Toujours dans la démonstration, le Monsieur IA de Meta rappelle qu’un enfant de 10 ans est capable de débarrasser une table et de remplir un lave-vaisselle tout seul, ce qu’aucun robot n’a jamais réussi à faire à ce jour. Idem pour les voitures autonomes de niveau 5 qui ne sont toujours pas déployées à grande échelle alors qu’un ado de 17 ans peut passer son permis après 20 heures de cours en auto-école.

Le machine learning des IA génératives n'est pas au niveau

Et si on veut pousser un peu plus loin la comparaison des capacités d’apprentissage d’un modèle d’IA générative face à un enfant de 4 ans, là aussi, il n'y a pas match. Yann Lecun nous apprend en effet que les deux millions de nerfs optiques d’un gamin - soit une bande passante par nerf estimée à 10 octets/sec - sont capables d’ingérer 50 fois plus de données en vidéo qu’une LLM (large language model, modèle d'IA générative) avec du texte sur le même temps d'apprentissage.

Le constat de Yann LeCun est lapidaire : le machine learning de ces modèles est « nul ». Pour repousser le niveau de l’IA générative qui, en 10 années de recherche, n’a jamais réussi à apprendre efficacement avec des objets comme des images et vidéos, il faudrait revoir l’approche et privilégier l’apprentissage par l’objectif.

Comprendre le monde, pour mieux raisonner et planifier

C’est la piste choisie par Yann LeCun avec son modèle d’IA axé sur les objectifs (Objective-Driven AI Architecture). Un modèle qui ne chercherait pas à reconstruire ce qui manque dans un texte ou une vidéo, mais qui pourrait construire une représentation abstraite de la réalité et faire la prédiction de ce qui se passe dans le contenu soumis. L’objectif étant de mettre au point un système capable de comprendre le monde, d’avoir un certain sens commun et de planifier des séquences d’action pour arriver à un but particulier.

Un système capable d’apprendre, par exemple, la physique de notre monde grâce à des vidéos et qui arriverait à la conclusion que « les feuilles d’un arbre qui s’agitent ou le reflet de la lumière sur la surface d’un lac ne sont pas des informations pertinentes à prédire ou à traiter ». Le parfait assistant IA en somme, capable de répondre à toutes nos questions, de mémoriser, de nous aider dans notre quotidien et de comprendre nos préférences et intérêts. Un premier modèle est déjà sorti des laboratoires de Meta, dénommé JEPA pour Joint Embedding Predictive Architecture.

Un long processus évolutif vers l'IA générale

Open source tout comme LLaMA, l’IA générative de Meta, JEPA en est à sa deuxième version et permettrait déjà de prédire les images manquantes d’une vidéo à l’aide de l’apprentissage auto-supervisé (V-JEPA), mais aussi de reconnaître le contenu d’une image (I-JEPA) ou, encore, de mesurer la hauteur de la canopée des forêts grâce à des images satellites.

De là à pronostiquer l’arrivée prochaine d’une intelligence artificielle générale ? Ce ne serait pas vraiment pour tout de suite d'après Yann LeCun. L’IA basée sur l’objectif ne serait qu’une étape dans l’évolution de l’intelligence artificielle. Un processus évolutif jalonné de nouveaux modèles « toujours plus intelligents » jusqu’à atteindre, un jour ou l’autre, l'Everest de l’IA. Une course où de nouveaux acteurs aux dents longues comme OpenAI et Mistral n’auront pas peur de bousculer l’ordre établi et de repousser toujours plus les limites de la science. En attendant, mon chat resterait plus intelligent que ChatGPT...