YouTube annonce être en bonne voie pour remplir son engagement en matière de filtrage de contenus inappropriés.

YouTube retire les vidéos violentes plus rapidement que jamais

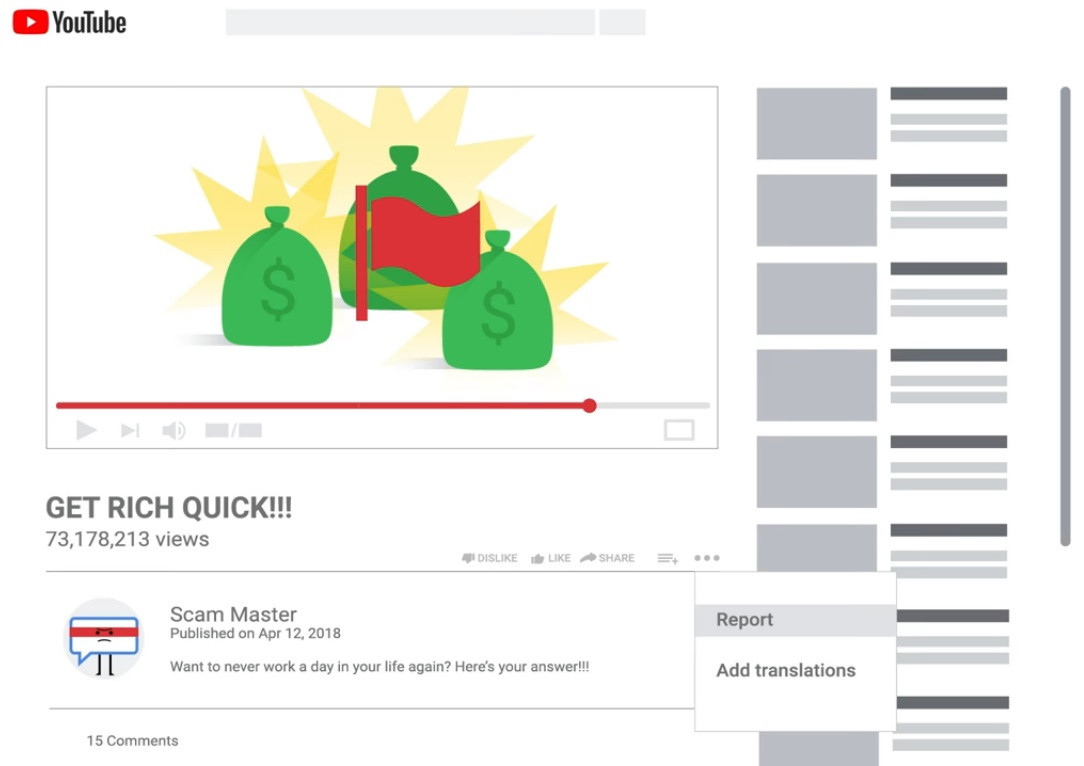

Les scandales autour de vidéos YouTube inappropriées sont légion ces derniers temps. Souhaitant montrer sa bonne foi, YouTube présente son premier observatoire de la modération, pour la période qui court de début octobre à fin décembre 2017. 8,2 millions de vidéos (surtout des vidéos spam et des vidéos pornographiques) ont été retirées au cours de ces trois mois. Cela peut paraître beaucoup, mais YouTube tient à nous rassurer : elles représentent moins d'1% de l'ensemble des vues sur la plateforme.Mieux encore : les vidéos les plus dangereuses sont retirées avant qu'elles n'atteignent un nombre de vues conséquent. Ainsi, la moitié des vidéos signalées en tant que vidéos terroristes sont désormais retirées avant qu'elles n'atteignent les 10 vues. Preuve que YouTube fait un bon travail en la matière : début 2017, seules 8% des vidéos terroristes étaient retirées avant d'avoir atteint les 10 vues.

Modération de YouTube : quand l'intelligence artificielle rencontre l'humain

Beaucoup de choses ont changé, ces derniers temps, dans la manière dont YouTube traite les vidéos inappropriées. Le second semestre 2017 marque un tournant en la matière : en trois mois, 6,7 millions de vidéos ont été signalées par l'intelligence artificielle, un record. Parmi ces dernières, 76% ont été retirées avant qu'elles n'aient eu une seule vue. Le répérage de vidéos douteuses à l'aide de l'intelligence artificielle, mis en place en juin 2017, a donc un bel avenir.Mais Youtube ne compte pas lever le pied sur le nombre de collaborateurs humains chargés du traitement de signalements de vidéos aux contenus inappropriés. Bien au contraire, leur nombre a augmenté et va encore augmenter d'ici fin 2018. Pour rappel, Google s'est engagé à bâtir une armée de 10.000 modérateurs avant la fin de l'année. Un objectif que YouTube a déjà quasiment atteint !