Une équipe du CSAIL, au MIT, a mis au point une nouvelle technique permettant à une personne de contrôler les mouvements d'un robot. Baptisée « Conduct-A-Bot », la technique utilisant les signaux électriques parcourant les muscles de l'utilisateur a été testée pour le pilotage d'un drone.

Pour les chercheurs, cette technique doit permettre de simplifier les interactions humain-machine.

Adapter les machines aux personnes, et non l'inverse

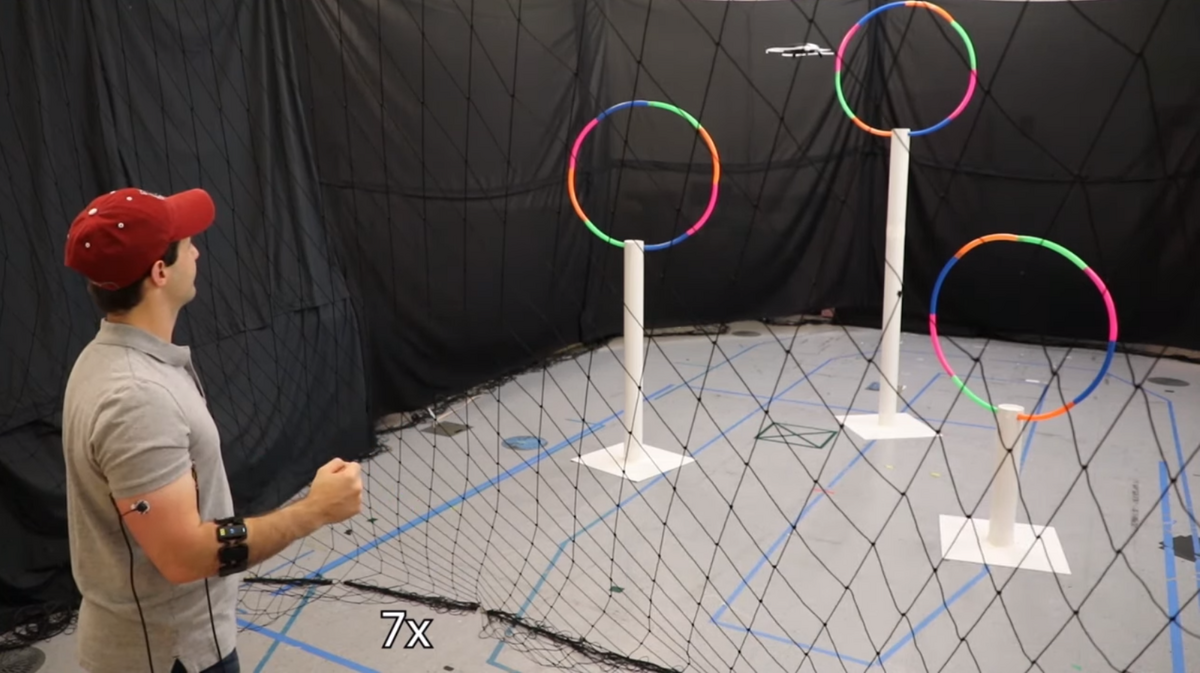

Ce système, qui nécessite uniquement la pose de quelques capteurs au niveau du biceps et de l'avant-bras - aucun capteur n'a été spécifiquement disposé dans l'environnement lors des tests - peut sembler particulièrement intuitif. Mais dans son communiqué, le MIT explique que l'intuition est « difficile à enseigner - en particulier à une machine ». Daniela Rus, la directrice du CSAIL ajoute : « Nous imaginons un monde dans lequel les machines aident les personnes par un travail cognitif et physique, et pour cela, elles s'adaptent aux personnes et non l'inverse ». En d'autres termes, et à l'aide d'algorithmes, le MIT souhaite montrer à une machine comment interpréter un ordre donné à l'aide d'un simple geste par une personne.Pour cela, les capteurs enregistrent les signaux qui traversent les muscles du bras et de l'avant-bras de la personne. Ceux-ci permettent d'interpréter une rotation du bras ou un mouvement de la main, les algorithmes se chargeant ensuite d'en déduire l'ordre donné : un simple geste vers la droite est interprété comme une volonté d'aller à droite.

Un système simple et des ordres basiques, qui visent à adresser la robotique à un public plus large, mais qui ne sont pas encore parfaits. Sur plus de 1 500 ordres donnés via des gestes, 81,6 % ont été correctement identifiés par le drone.

Améliorer la préhension

L'utilisation de capteurs pour la détection de signaux dans les muscles permettrait également une meilleure préhension des objets. Le communiqué indique : « par exemple, si vous regardez la vidéo de quelqu'un tenant une boîte, vous aurez du mal à deviner quel effort ou quelle force est nécessaire (pour la déplacer) - et une machine aura également du mal à mesurer cela à partir de la seule vision. L'utilisation de capteurs musculaires ouvre la possibilité d'estimer non seulement le mouvement, mais également la force et le couple requis ».Selon l'équipe, le système « Conduct-A-Bot » pourrait être utilisé dans différents cas de figure, notamment la navigation dans les menus d'appareils électroniques ou la supervision d'appareils autonomes. Il pourrait être intégré à des appareils destinés à la manutention, à l'assistance aux personnes ou à l'exploration à distance.

Dans le cas d'un drone, le système est susceptible de donner toutes sortes d'ordres à l'appareil. Les chercheurs ajoutent avoir utilisé un drone Bebop 2 de la marque Parrot pour les tests, mais précisent que n'importe quel drone disponible dans le commerce pourrait être manipulé de la sorte.

Joseph DelPreto, l'auteur principal de l'étude affirme que « la compréhension de nos gestes pourrait aider les robots à mieux interpréter les signaux non verbaux que nous utilisons naturellement dans la vie de tous les jours. Ce type de système pourrait aider à rendre l'interaction avec un robot plus proche d'une interaction avec une autre personne, et à faciliter le lancement de robots sans expérience préalable ni capteurs externes ». L'équipe entend d'ailleurs tester son système sur davantage d'appareils.

Source : MIT